与行业内常见的不具备互动性的 3DoF 实拍纪录片以及不具备写实性的游戏引擎制作的 6DoF 纪录片不同,《跟着德爷闯东非》纪录片的拍摄采用空间重建技术及虚实融合技术,兼顾实拍和虚拟互动,以全新的 6DoF 互动体验,增强了 VR 内容的沉浸性和交互性,让用户跟随德爷的脚步沉浸式体验从城市“跃入”荒野的快感。

全新 VR 空间互动性的挑战和难点

传统 VR 实拍视频的交互通常采用不同选项触发不同结局的 AB 型互动方式,而《跟着德爷闯东非》想要实现的是全新的 VR 空间互动,用户可以抓起虚拟世界中的物体完成任务,比如和德爷一起钻木取火,也可以在场景中自由走动,在非洲草原和德爷一起追捕猎杀珍珠鸡,实现全新的交互并达到高沉浸感,突破传统视频的界限。

而想要实现全新的交互和体验高沉浸感,需要做到:

空间重建,复原现实世界

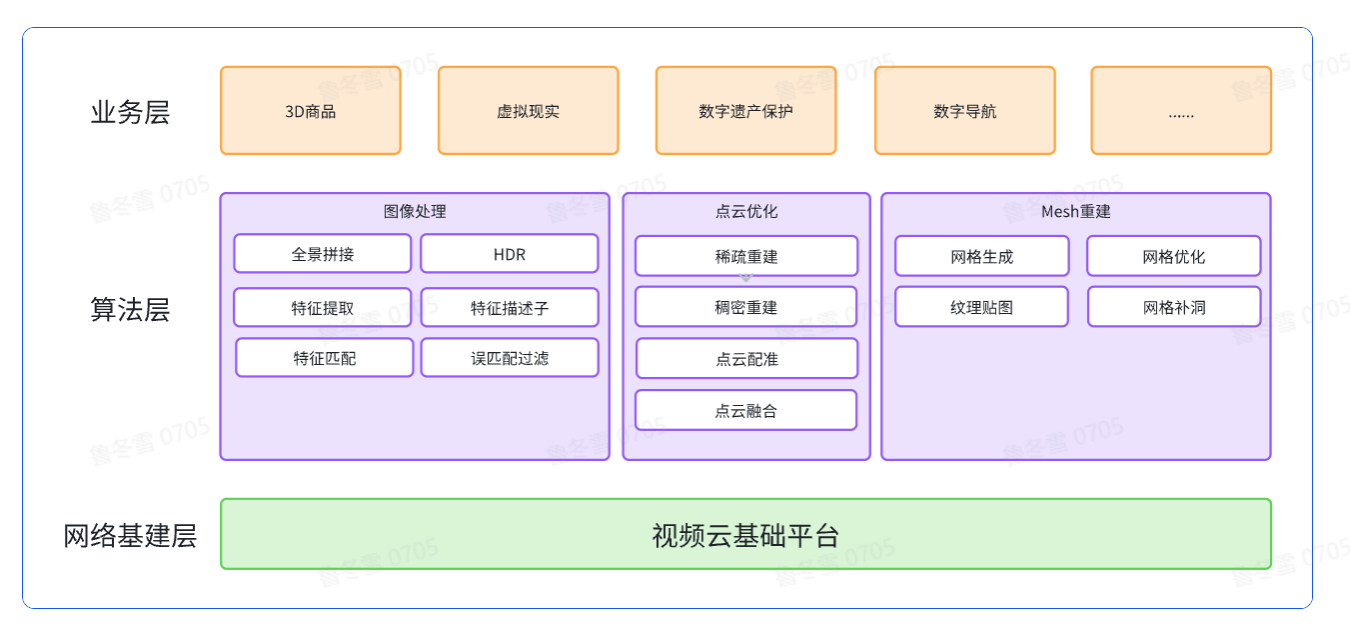

空间重建技术能够复原现实世界的场景和物品并转化为数字资产,是计算机视觉和摄影测量中的重要研究课题,也在智慧城市、虚拟现实、数字导航与数字遗产保护等方面有着重要的应用。

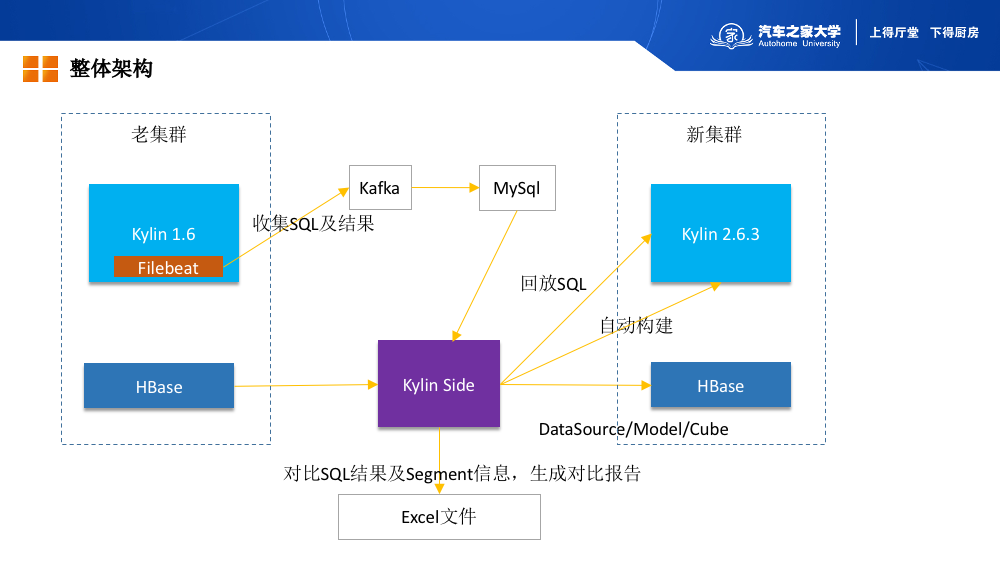

目前,火山引擎视频云平台具备自动化空间建模链路,助力大场景重建,可支持采集 RGBD/RGB 数据(无人机、手持采集等)自动化上传云平台,2-4 小时后自动产出建模结果,建模精度可达 1cm~2cm。同时,火山引擎视频云的云渲染可视化系统,联合自研动态传输算法,可实现高度真实感的模型渲染。

图:火山引擎视频云三维重建平台

火山引擎多媒体实验室将神经辐射场技术(NeRF)与自研大场景建模技术相结合,研发行业领先的大场景光场重建方案,实现高度真实感(psnr>30)的场景重建、复现及后编辑。

在具体实践的场景中,动态物体会使 NeRF 重建出现伪影,借助自研动静态分割、影子检测、inpainting 等算法,对场景中和几何不一致的区域进行提取、修复。同时借助自研高精度 SFM 算法框架,对场景进行高精度的几何重建,包括相机参数估计以及稀疏、稠密点云生成。另外,对场景进行拆分以减小单次训练资源消耗,并可做分布式训练、维护。在神经辐射场训练过程中,针对室外无边界大场景,团队通过优化策略以提升该场景下的新视角生成效果,比如,通过在训练中同时优化位姿提高重建精度、基于哈希编码的层次化表达提升模型训练速度、借助外观编码提升不同时间采集场景的外观一致性、借助 mvs 稠密深度信息提升几何精度等。

以团队同毫末智行合作为例,完成单路采集以及多路合并的 NeRF 重建,相关成果已在毫末 AI Day 发布。

虚实融合,提升用户体验

为提升用户沉浸式体验,火山引擎多媒体实验室自研 虚实融合技术,将环境实拍全景图与场景模型进行对齐、融合。 团队利用先进的人工智能技术,建立全景图图像特征与模型关键点的匹配关系,通过 PnP 算法以及光束法平差算法将全景图注册至场景模型坐标系,实现尺度、位置的统一,从而实现模型渲染与实拍全景视频渲染的统一,达到虚实融合的效果。

同时,为扩大用户体验的自由度,团队针对该场景自研非球面天空盒渲染,克服传统的球面全景图渲染仅在图像采集中心视觉一致的缺陷,进一步提升实拍全景图渲染模型与地形模型的匹配程度,以实现更大运动范围的视觉一致性,进一步提升沉浸式体验。

物品重建,高精度还原细节

在《跟着德爷闯东非》互动纪录片中,会有用户虚拟体验探险剧情的桥段,例如钻木取火,木棍训蛇等。为了带来真实的体验,道具往往是在实际拍摄过程中就地取材,有细长的树枝,薄薄的小刀,还有形态复杂的篝火堆。这些道具的重建本身是比较有挑战的,再加上整个拍摄过程比较紧张,留给扫描的时间并不充裕。为此,火山引擎视频云团队沉淀出一套采集方便,操作简单,能还原各类复杂物品的重建系统。

为了重建形状比较复杂的道具(例如狭长的木棍、锋利的小刀)。火山引擎视频云采用符号距离场(Signed Distance Fields,简称 SDF)的技术方案来表示三维物体,结合 深度学习 的方法克服了以上重建难点。对于如何监督神经网络使其准确地拟合该 SDF,火山引擎视频云先用运动恢复结构(Structure from Motion,简称 SfM)算法,精确计算拍摄图像的相机姿态,再利用 可微渲染 的方法将 SDF 所表示的空间信息渲染到图像上,把渲染得到的图像和该视角下采集的图像做比较,不断优化神经网络,使 SDF 在各个采集视角下的渲染结果尽可能与实际采集的图像一致。为了进一步提高重建精细度,在优化 SDF 的时候加入稀疏重建得到的三维点做约束,能更好的还原物体的 细节特征 。

交互技术,让玩法更丰富

采用虚实融合技术可以构造由空间重建模型和实拍 360°VR 视频两部分构成的 6DoF 互动场景,同时在《跟着德爷闯东非》项目中,多媒体实验室也实现了终端上的交互技术,同内容团队一起创造出了很多有创意性的虚实结合的玩法。

拍照功能

使用离屏相机管道,把从全景视频球上投影出的针孔 2D 图像重新贴在玩家手持的相机模型上,以实现出玩家可以对环境中任意角度拍照的玩法。

物品交互功能

火山引擎多媒体实验室可以估计 VR 视频中的深度信息,结合 3D 虚拟空间中的虚拟物体的位置信息,计算出全景视频球上指定视频元素,对应于玩家在真实的 3D 空间下的位置。从而,实现视频画面上真实物品转换到玩家可交互虚拟物品模型的无缝转换的玩法。

虚实融合技术的广阔应用

虚实融合技术目前正处于快速发展的阶段,在众多领域中展现出广阔的应用前景。如游戏、教育和医疗等领域,已开始积极探索虚实融合技术的应用,并取得了不错的成绩:

以上内容在火山引擎视频云与 NVIDIA 团队合作推出的《云上新视界》线上课程内进行了详细解读。《云上新视界》致力于打造一档以音视频创新场景与最佳实践为核心内容的系列视频栏目,内容覆盖赛事直播、6DoF 互动体验、3D 人体重建、弹幕游戏等火爆热门场景,为行业注入新鲜力量和创新源泉。