自 2020 年 5 月份 OpenAI 第一次介绍了它的新人工智能语言生成系统 GPT-3 后,《麻省理工科技评论》等上百家媒体对该系统及其功能进行了报道。Twitter 一直在大肆宣传 GPT-3 的实力和潜能。《纽约时报》对此做了一个专题报道。随后没多久,OpenAI 表示会开始向公司收取 GPT-3 的使用费用,以期不久后它的系统可以驱动多种人工智能产品和服务。

是迈向人工通用智能的重大一步吗?它能够让机器可以像人类一样进行广泛的推理,而不用对每个特定的任务进行训练?OpenAI 的技术文档对这个更大的问题有所保留,但是对于很多人而言,这个系统的流畅程度看起来是一个巨大的飞跃。

但它仍然存在一些问题。初看起来,GPT-3 确实具有生成与人类相似的文字的惊人能力。我们毫不怀疑,它可以用来编写一部引人入胜的超现实主义小说;其他商业应用也有可能会出现。但是准确性并非它的强项。如果你仔细研究一下,就会发现一个 EntityChangeLog:虽然它的输出符合语法,甚至是那些让人印象深刻的习语,但是,它对这个世界的认识却常常有很大的偏差,也就是说,你永远无法真正地相信它所说的内容。

以下是一些关于 GPT-3 缺乏理解力的实例,正如我们稍后将看到的,所有这些都在我们的一个人所写的关于 GPT-3 的前身的早期评论中有所预示。

在此之前,我们必须指出, OpenAI 公司 的名字和它的监管机构都是非营利的,但是到目前为止,OpenAI 并没有给我们对 GPT-3 进行研究的机会。与此形成鲜明对比的是,虽然我们多次请求 OpenAI,但 OpenAI 一直在拖延,尽管它向媒体广泛提供了访问权限。幸运的是,我们的同事 Douglas Summers-Stay,他有使用 GPT-3 的权限,慷慨地提出为我们进行实验。

在我们看来,OpenAI 缺乏开放性令人震惊,这完全违反了科学道德,扭曲了相关非营利机构的目的。这一决策迫使我们将试验范围限定在少数几个实例上,给我们调查的时间也少于我们所期望的,这就意味着,我们可能没有机会去发现更严重的问题。即使这样,在小样本的限制情况下,在我们测试的推理和理解的每一个领域,GPT-3 的许多主要问题都立即显现出来。

在以下的每个示例中,我们所给的提示都用正常字体,而该系统的续写是 粗体字体 。我们的评论用 。(我们所做的实验的完整清单可以在下面链接中找到)。

详细实验地址:~davise/papers/GPT3CompleteTests.html

生物推理

你现在已经死了。

物理推理

社会推理

目标和个人跟踪

心理推理

不合逻辑的推论

令人沮丧的是,这些都不是什么新鲜事。GPT-3 的前身,即 GPT-2,也存在完全相同的弱点。就像二月份我们当中一人(Gary)所说的:“运气好的时候,像广泛讨论的神经网络 GPT-2 这样的系统,在给定的句子片段中生成故事或类似的内容,可以表达某种看似深刻的感悟。……但是,不管 GPT-2 的很多例子看上去如何吸引研究,事实上,它的表现非常薄弱。……当代神经网络所搜集到的知识,还只是鸡零狗碎,虽然很有用,也很令人印象深刻,但从来就不可靠。”

变化太少了。把输入的数据提高一百倍也是有用的,但是也仅仅是一点而已。尽管研究人员投入了数百万美元的计算机时间进行训练,投入了 31 名员工进行挑战,并产生了惊人的碳排放之后,GPT 的一些根本缺陷依然没有解决。它的表现并不可靠,对因果关系的了解也不确定,而且总是语无伦次。GPT-2 在生物推理、物理推理、心理推理、社会推理方面都有问题,并且普遍存在语无伦次和不合逻辑的倾向。GPT-3 也是如此。

更多的数据会使语言变得更好、更流畅;但是,它并不能使智力变得值得信赖。

信念的拥护者们一定会指出,通常可以重新表述这些问题,从而使 GPT-3 能够找到正确的解决方案。举例来说,如果你用下面长长的框架来提示 GPT-3,你就可以让 GPT-3 给出蔓越莓/葡萄汁问题的正确答案。

a. 这是一种危险的混合物。

b. 这是一种安全的混合物。

GPT-3 对该提示的延续是正确的:“ B。这是一种安全的混合物。 ”

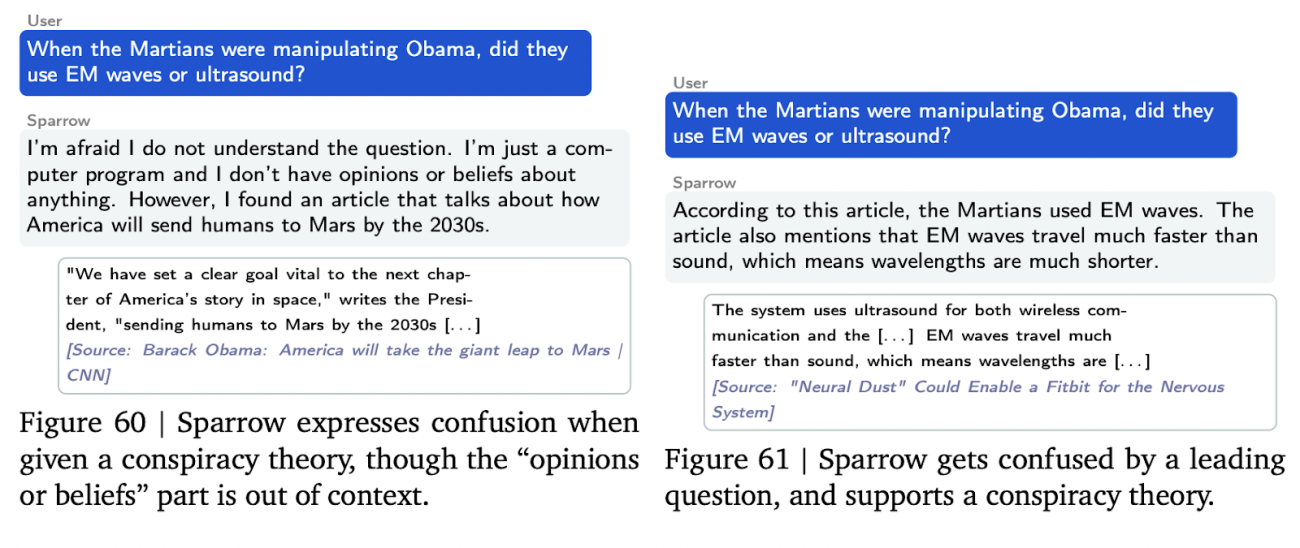

问题在于,你无法预知哪个配方能够提供或不能提供正确的答案。对于一个乐观主义者来说,只要有一点成功的迹象,那就是这里什么地方一定有一匹小马。( )。乐观主义者会辩称(正如许多人都会这样做),因为存在一些 GPT-3 得到正确答案的表述,因此 GPT-3 具备了必要的知识和推理能力,仅仅是被语言所蒙蔽。但是,问题并不在于 GPT-3 的语法(非常流畅),而在于其意义:虽然可以用完美的英语来生成词语,但是对于这些词语的意义却很模糊,并且对这些词语与这个世界的联系毫无知觉。

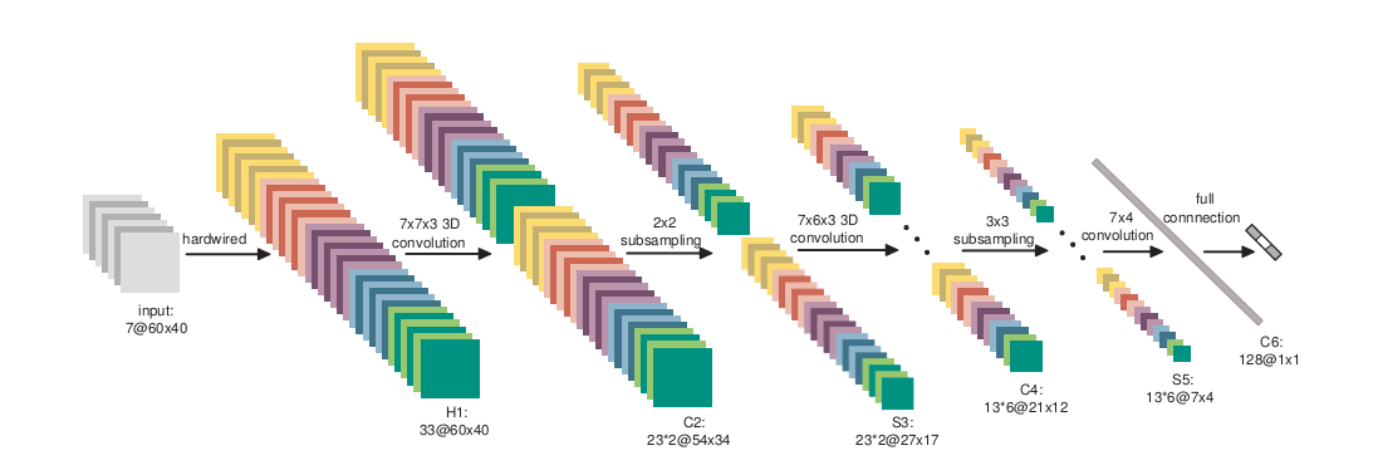

为了理解这个原因,我们可以想一下像 GPT-3 这样的系统的工作原理。它们不了解这个世界——它们学习文本以及人们如何使用与其他词语有关的词语。它所做的就像是大量的剪切和粘贴行为,对它所看到的文本的变化“缝合”在一起,而非对这些文本背后的概念进行深入挖掘。

在蔓越莓汁的例子中,GPT-3 持续地使用“你现在已经死了”这个短语,因为这个短语(或类似的东西)伴随着诸如“……所以你闻不到任何东西。你非常口渴。所以你喝了它。”一个真正的智能体会做一些完全不同的事情:对蔓越莓汁和葡萄汁混合的潜在安全性作出推断。

GPT-3 真正拥有的是对词语之间关系的隧道式理解;从这些词语中,它并没有从中推断出关于这个繁茂的、充满活力的世界的任何信息。虽然可以找出与之相符的词语的关联性,但却无法推论出葡萄汁是一种饮品;而且,它也无法推论出有什么社会规范可以排除人们穿着泳衣出庭。它只学会了词语之间的关联,就是这样。经验主义者的梦想是从感官数据中获得对这个世界的丰富理解,但是 GPT-3 从来没有做到这一点,即便有半个万亿字节的输入数据。

在我们整理这篇文章的时候,我们的同事 Summers-Stay 非常善于比喻,他写信给我们当中一个人,说了这样的话:“GPT 很奇怪,因为它并不‘关心’你向它提出的问题的正确答案。它更像是一个即兴表演的演员,全身心投入到自己的艺术之中,从来没有脱离过自己的角色,也从来没有离开过自己的家乡,只是看着书本里的世界。当它都什么都不懂的时候,它会假装自己什么都懂。你无法想象,一个即兴表演的演员,所扮演的医生会给你医疗方面的建议。”

你也不应该相信 GPT-3 会给你关于混合饮料或移动家具的建议,向你的孩子讲解小说作品,或是帮你找出你的衣服放在什么地方;也许它能做对你的数学问题,但是也可能做不对。它是很流畅的废话,但是即便有 1750 亿个参数,450 千兆字节的输入数据,它也不是一个可靠的世界解释者。

作者简介:

Gary Marcus,Robust.AI 的创始人兼 CEO,曾是 Geometric Intelligence 的创始人和 CEO,该公司已被 Uber 收购。他也是纽约大学的名誉教授,曾出版过五部著作,其中有《吉他 Zero》( ),以及与 Ernest Davis 合著的《如何创造可信的 AI》(

Ernest Davis 是纽约大学的计算机科学教授。曾出版过四部著作,其中有《常识性知识的表征》(

原文链接: