云计算加速了企业数字化和智能化的进程。当 AI 开始更深层次地被嵌入到企业发展的链路之中,新一代算力、大模型、AI 基础设施的推出就变得势在必行。正如百度集团执行副总裁、百度智能云事业群总裁沈抖所言:“AI 原生时代正在加速到来,这对云计算的基础设施提出了新要求,全栈融合、端到端优化、提供极致的资源效能和模型效能,成为未来智能计算发展的三大主流方向。”

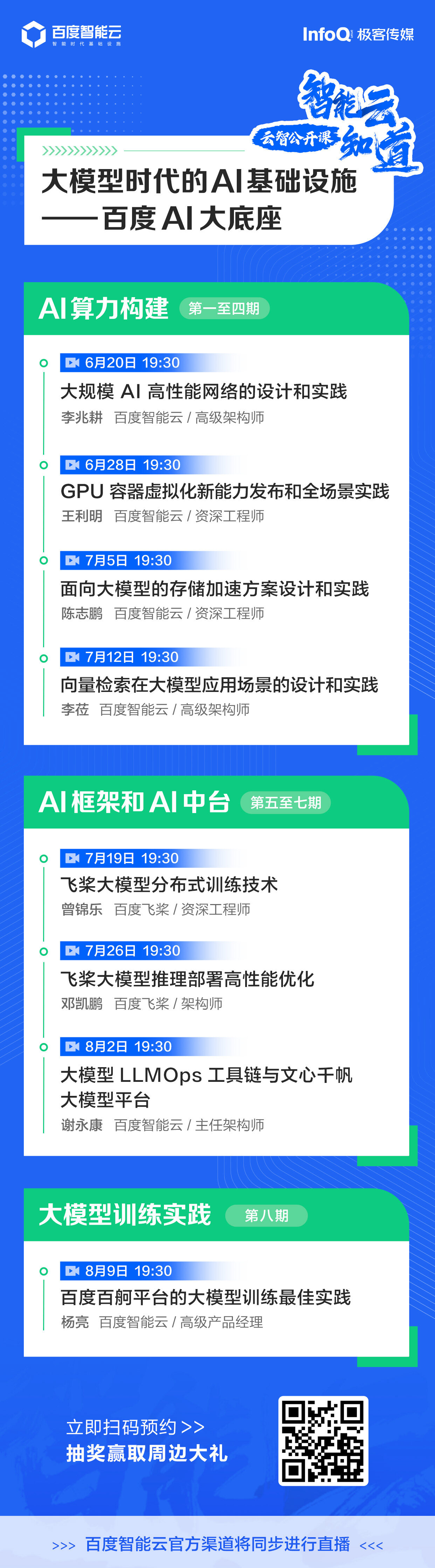

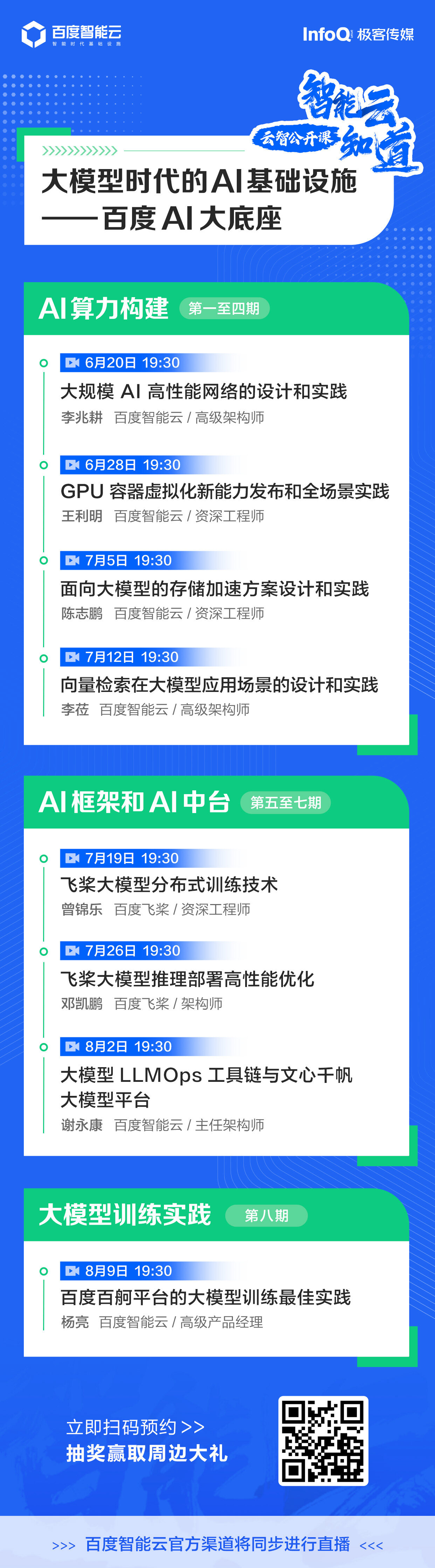

为了让大家更全面地了解 AI 技术的前沿发展趋势及技术实践,百度智能云团队特推出《大模型时代的 AI 基础设施——百度 AI 大底座》系列云智公开课,该课程将围绕“AI 算力构建”、“AI 框架和 AI 中台”、“大模型训练实践”三大主题展开,由多位专业大咖倾情打造,揭秘核心技术,直击行业痛点。

目前我们都关注到大模型热潮下 ,AI 算力升级已是大势所趋。

大模型落地第一步就是要构建起能够提供大规模的 AI 算力的基础设施,包括将海量 AI 算力进行聚合的高性能网络、高效率的异构资源管理方式、为大模型落地的各个环节提供匹配的存储加速方案、为向量检索及其海量数据存储提供的各项方案等。

面对以上技术挑战,百度智能云探索出一套“武林秘籍”。自 6 月 20 日起,这些“秘籍”将在《大模型时代的 AI 基础设施——百度 AI 大底座》系列云智公开课第一大主题——“AI 算力构建”课程直播中陆续进行解读,欢迎大家关注并预约~

第一讲:《大规模 AI 高性能网络的设计和实践》

第二讲:《GPU 容器虚拟化新能力发布和全场景实践》

第三讲:《 面向大模型的存储加速方案设计和实践 》

第四讲:《 向量检索在大模型应用场景的设计和实践 》

第一讲课程《大规模 AI 高性能网络的设计和实践》上线时间为 2023 年 6 月 20 日 19:30-21:00 ,目前课程报名通道现已开启,立即点击链接进行报名,还有机会抽奖赢取周边大礼哦!